LLM-as-a-Judge: Il rumore che non vedi

LLM-as-a-Judge funziona — se sai quali bias evitare. Una guida pratica ai 4 errori sistematici e come correggerli per valutazioni più affidabili.

Gli LLM moderni non vengono addestrati solo su grandi quantità di testo — vengono anche allineati con le preferenze umane attraverso un processo chiamato RLHF (Reinforcement Learning from Human Feedback), in cui valutatori umani giudicano le risposte del modello e il sistema impara a replicare quel tipo di ragionamento. Il risultato è un modello che non si limita a generare testo, ma che ha interiorizzato una forma di giudizio qualitativo.

Ed è esattamente questa capacità che lo rende un candidato naturale per assumere ruoli valutativi tradizionalmente riservati a esperti umani — usare un LLM come giudice per valutare, confrontare o classificare gli output di altri LLM secondo criteri espliciti (LLM-as-a-Judge). Ma costruire un LLM Judge affidabile non è banale. Cosa tenere sotto controllo e cosa fare per non sbagliare?

Progettare contro il rumore

Gli LLM Judge non sbagliano a caso — sbagliano in modo prevedibile. La ricerca ha documentato bias sistematici che alterano le valutazioni: self-preference bias (i modelli premiano output affini al proprio stile), position bias (favoriscono la prima o l'ultima risposta), verbosity bias (premiano le risposte più lunghe), scoring bias (cambiano giudizio per dettagli irrilevanti come l'ordine della rubrica). Conoscerli cambia il modo in cui si progetta un sistema di valutazione affidabile.

Il giudice allo specchio

La prima accortezza è evitare che il modello valuti testi prodotti da sé stesso o da modelli troppo affini — ad esempio far valutare a GPT-4o un output generato sempre da GPT-4o è esattamente il tipo di errore che sembra innocuo e non lo è. Come un professore che rilegge un elaborato già valutato tende a confermare il voto precedente, quasi incapace di separare la qualità reale dall'impressione lasciata dalla prima lettura.

Secondo Kahneman in Rumore, il professore non sta riconoscendo l'errore — sta riconoscendo lo stile familiare, e lo premia. Gli LLM fanno la stessa cosa. Questo effetto — il self-preference bias — non si limita al singolo modello, ma si estende all'intera famiglia.

Un gruppo di ricercatori di SB Intuitions (Wataoka et al.,2024) hanno introdotto una metrica quantitativa per misurare questo bias, dimostrando che GPT-4 è il modello con il bias più marcato: in una valutazione pairwise su 33.000 dialoghi del dataset Chatbot Arena, GPT-4 seleziona la propria risposta come vincente nel 94.5% dei casi in cui anche gli umani la preferivano, ma solo nel 42.5% dei casi in cui gli umani preferivano l'altra — una differenza (bias score) di 0.52.

La causa, secondo gli autori, è legata alla perplexity, una misura di quanto un testo "sorprende" il modello: più un testo è simile a ciò che il modello genererebbe, più la perplexity è bassa — e più il giudice lo valuta positivamente, indipendentemente dalla qualità reale. In pratica gli LLM non riconoscono i propri output, ma premiano lo stile che conoscono meglio: il proprio.

Il bias non riguarda errori fattuali ma differenze di stile — come il modo in cui GPT-4 tende a premettere spiegazioni e premesse prima di rispondere, preferendo questo pattern anche quando una risposta diretta sarebbe più appropriata. Uno studio sul fenomeno del preference leakage ha dimostrato che questa contaminazione si propaga all'intera famiglia di modelli: usare LLM affini per generazione e valutazione altera sistematicamente i giudizi.

Per ridurre questo rischio è preferibile separare nettamente il modello che genera l'output da quello che lo giudica: se il tuo sistema usa GPT per rispondere, usa Claude, Gemini o LLaMA per valutare.

L'ordine cambia tutto

Cosa cambia se presenti le stesse informazioni in ordine diverso? In Rumore, Kahneman risponde con un esperimento semplice. Due gruppi valutano lo stesso candidato con i medesimi quattro aggettivi, ma in ordine inverso. Chi legge prima "intelligente" e "tenace" si forma un'impressione positiva, e "spregiudicato" diventa quasi trascurabile. Chi legge prima "spregiudicato" costruisce un'impressione negativa, e "intelligente" rende il candidato ancora più pericoloso. Stesse parole, ordine diverso, giudizio opposto.

Negli LLM judge lo stesso meccanismo prende il nome di position bias — i giudici tendono a favorire la prima o l'ultima risposta presentata. Zheng et al. (2023) lo hanno quantificato su MT-Bench: Claude-v1 con prompt default mostrava un bias del 75% verso la prima risposta con solo il 23.8% di consistenza; GPT-3.5 arrivava al 50% di bias verso la prima posizione; GPT-4 era il più robusto con il 65% di consistenza, ma non immune. Shi et al. (2024), in uno studio sistematico su oltre 100.000 istanze di valutazione, hanno confermato che il position bias è un fenomeno robusto e pervasivo in tutti i giudici LLM testati.

La soluzione è chiedere al giudice di esplicitare prima un rationale, un piano di valutazione esplicito, e solo successivamente emettere il verdetto. Jiao et al. (2024) hanno dimostrato che il Chain-of-Thought prompting riduce con successo il bias posizionale in tutti i valutatori LLM testati, e Zheng et al. stesso mostrarono che passare dal prompt default al CoT riduceva il failure rate da 14/20 a 6/20 su task matematici — un passaggio che stabilizza il giudizio e lo rende meno sensibile a queste distorsioni.

La risposta giusta può essere breve

Un medico che spiega una diagnosi con termini tecnici, riferimenti a studi e una lunga premessa sulla complessità del caso ci sembra più competente di uno che dice semplicemente "è un'influenza, tornerà a casa in tre giorni". Anche se hanno ragione entrambi.

Gli LLM non hanno inventato il verbosity bias — faceva già parte di noi. In Thinking, Fast and Slow e poi ancora in Rumore, Kahneman lo aveva già descritto come l'illusione di validità: più una spiegazione è articolata e coerente, più ci appare affidabile, anche quando non è più accurata.

L'LLM Judge tende a premiare le risposte più lunghe indipendentemente dalla qualità sostanziale. Ye et al. (2024), nel paper "Justice or Prejudice? Quantifying Biases in LLM-as-a-Judge", hanno quantificato sistematicamente questo fenomeno su 12 dimensioni distinte, mostrando che anche i modelli più avanzati cadono nella trappola della prolissità. Non è un caso: è un artefatto del pre-addestramento generativo e dell'RLHF, che ha abituato i modelli ad associare lunghezza e formalità a qualità.

La mente umana confonde ricchezza narrativa e correttezza. L'LLM judge, addestrato su giudizi umani, ha imparato a fare lo stesso. Una risposta lunga "suona" più competente, quindi viene premiata.

La risposta giusta può essere breve. Il giudice non sempre lo sa. Per questo le rubriche di valutazione devono tenere esplicitamente conto della concisione — penalizzando la verbosità non necessaria, non premiandola.

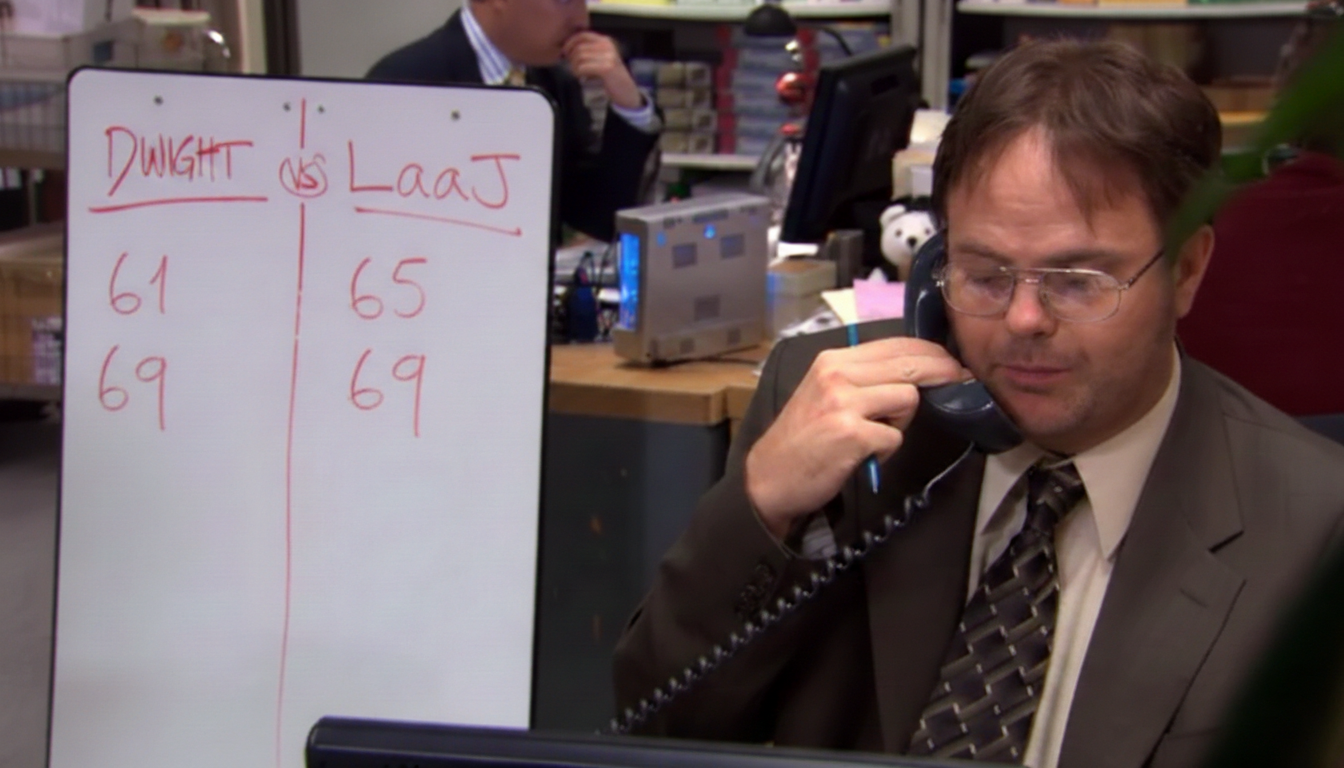

Perché avete scelto 65 e non 61 o 69?

Kahneman descrive il giudizio come una misurazione il cui strumento è la mente umana. E come ogni strumento di misura, è sensibile al contesto in cui viene usato — anche quando quel contesto non dovrebbe influenzare nulla. "Perché avete scelto 65 e non 61 o 69?" chiede Kahneman ai lettori che hanno appena espresso un giudizio su un candidato.

La risposta, scomoda, è che spesso non lo sappiamo.

Lo scoring bias è il più facile da trascurare — e il più difficile da giustificare. Li et al. (2025) hanno condotto il primo studio dedicato allo scoring bias negli LLM judge, identificando tre tipi inediti: rubric order bias (cambiare l'ordine della scala di valutazione), score ID bias (usare identificatori numerici invece che romani o letterali) e reference answer score bias (modificare la qualità della risposta di riferimento).

I risultati sono eloquenti: GPT-4o mostra un flip rate tra il 15% e il 28% semplicemente cambiando l'ordine della rubrica o il tipo di identificatore. Per modelli più piccoli come Qwen3-8B, il flip rate arriva fino al 46%. Quando si modifica il punteggio della risposta di riferimento, il flip rate raggiunge il 45% anche per GPT-4o.

La mente umana sceglie 65 invece di 61 per ragioni che non sa spiegare. L'LLM judge cambia verdetto perché hai usato "I" invece di "1".

Il problema è lo stesso — cambia solo la scala.

Valutando il rumore

Conoscere i bias non basta — bisogna progettare il sistema per tenerli sotto controllo. Piattaforme come LangFuse o Phoenix Arize permettono di tracciare le valutazioni nel tempo, confrontare versioni del prompt e rilevare derive nel comportamento del giudice prima che diventino un problema. Come qualsiasi altro componente critico in produzione, il sistema di valutazione va versionato, monitorato e calibrato.

La survey di Gu et al. (2024), il riferimento più completo sul tema con oltre 1.100 citazioni, raccomanda esplicitamente di impostare la temperatura a zero per ridurre la variabilità stocastica.

Stureborg et al. (2024) confermano empiricamente che una singola generazione a temperatura 0 migliora la consistenza delle valutazioni. In pratica: output del giudice in formato JSON — separando decisione e spiegazione — prompt snello e focalizzato sui criteri rilevanti. Prompt troppo lunghi tendono a favorire risposte prolisse indipendentemente dalla qualità reale — e a quel punto non stai più valutando il sistema, stai valutando il rumore.

📚Bibliografia

[0] Daniel Kahneman , Pensar rápido, pensar despacio, Penguin Random House, Prima edizione, 2012

[1] Daniel Kahneman , Ruido: Una falla en el juicio humano, Penguin Random House, Prima edizione, 2021

🔎Papers

[0] Wang, Peiyi et al., Large language models are not fair evaluators, arXiv preprint arXiv:2305.17926, 2023

[1] Yang et al., G-EVAL: NLG Evaluation using GPT-4 with Better Human Alignment, arXiv:2303.16634, 2023

[2] Zheng et al., Judging LLM-as-a-Judge with MT-Bench and Chatbot Arena, arxiv:2306.05685, NeurIPS, 2023. Il paper fondamentale su LaaJ. Dimostra che GPT-4 raggiunge oltre l'80% di accordo con le preferenze umane (lo stesso livello osservato tra due valutatori umani). Definisce LaaJ come "a scalable and explainable way to approximate human preferences." . Introduce pairwise comparison e single-answer grading come protocolli di valutazione.

[3] , RevisEval: Improving LLM-as-a-Judge via Response-Adapted References, arXiv:2410.05193, 2024

[4] Gu et al., A Survey on LLM-as-a-Judge, arxiv:2411.15594, 2o24. Survey completo che copre scalabilità, costo-efficacia, consistenza e strategie per migliorare l'affidabilità dei giudici LLM.

[5] Ye et al., Justice or Prejudice? Quantifying Biases in LLM-as-a-Judge, arxiv:2410.02736 , 2o24. Quantifica i bias dei giudici LLM (posizione, verbosità, self-enhancement).

[6] Li et al., Judging the Judges: A Systematic Study of Position Bias in LLM-as-a-Judge, 2025

[7] Li et al., From Generation to Judgment: Opportunities and Challenges of LLM-as-a-judge, arxiv:2411.16594 , 2025. Survey che documenta come le metriche tradizionali (matching-based) falliscano in scenari open-ended e dinamici, e come gli LLM offrano valutazioni multi-dimensionali.